【白夜谈】我原来已经被AI包围

大概半年前,我开始在短视频平台频繁听到一位小哥的配音,声线比较有代表性,就是20岁左右青春男孩又略带忧郁的声音,听起来是这样的:

我时不时就会刷到这位小哥的配音,出于职业嗅觉,我认为,应该是短视频行业兴起后,产生了大量的配音需求,所以便有MCN机构聚集起了一些声优来专门承接这种工作。看来这个小哥挺火,特别是电影解说类号,很喜欢用它来配音。

随后的一些日子里,我眼见小哥的声音出现在越来越多的短视频里,各种营销号都在找他配音,不由得感慨他们公司业务拓展之快。直到有一天,我去菜市场买菜,从菜贩子的手机也传来了熟悉的声音……

按照身边有限样本量来估算的话,这小哥每天要配音的内容也太多了,接得过来吗?我向一位朋友表达了疑惑,朋友跟我说,你再仔细听听,这些都是AI配音。

我又仔细听了一下,发现果然是AI配音,个别词语断句的时候会有微妙的不自然,但不认真听很难听出来。按照短视频的观看场景,很容易当成是真人的声音。

按照这个思路,我又把之前看过的一些其他短视频翻出来筛了一遍,发现其实之前看的很多视频都是AI配音的。即便不是那个小哥的经典声音,也是换了个别的“虚拟声优”而已,同样,它们不留心的话很难听出来。

这个发现让我很震撼。虽然这几年AI发展突飞猛进,但对于不接触开发工作的大众网友来说,平时大家能感知到的案例,要么是deepfake色图刷存在感,要么就是一些看起来高科技但和自己没什么关系的新闻,比如什么围棋/星际大赛神仙打架,AI车手在游戏里战胜世界冠军什么的。短视频的AI配音,是我第一次感到质变后的AI会如此直接地改变普通网民的内容消费和创作体验。

是的,这几年深度学习技术改变让AI的整体水平发生了质变,虽然离科幻作品里那种通用AI还有很大差距,但在图像/声音/语言方面专业方面,AI已经展现出了与5年前截然不同的水平。过去,机器合成音与真人语音天差地别,那些蹩脚的TTS语调和异常的停顿能让任何人轻易分辨出来不是真人,但现在,即便在民用领域,要分辨真假已经不那么容易——你每天接到的骚扰电话就有很大比例是AI打的,是不是还跟对方聊过几句?

当然,以假乱真的AI语音不算新鲜技术。去年7月,微软的AI小冰就曾发布过一个视频来演示他们的“超自然语音合成技术”,当时便给了观众扑面而来的技术感:

如果上面这个视频你看到结尾,会发现旁白的女声其实也是AI。但举这个例子并不是说去年这个演示有多厉害,恰恰相反,半年之后再看,这个演示已经不那么厉害了,侧面反映出了AI配音技术的应用和发展之快,从演示到商用比人们过去的习惯快了不少。

有意思的是,本文开头那个频频出现的配音小哥,最后我还真的找到了他的“本尊”。在国内一家配音平台上,有一位叫魔云熙的AI声优,他的音色与无数短视频中无异,并且提供了从“恐惧”到“欢快”等不同情绪风格供人选择。

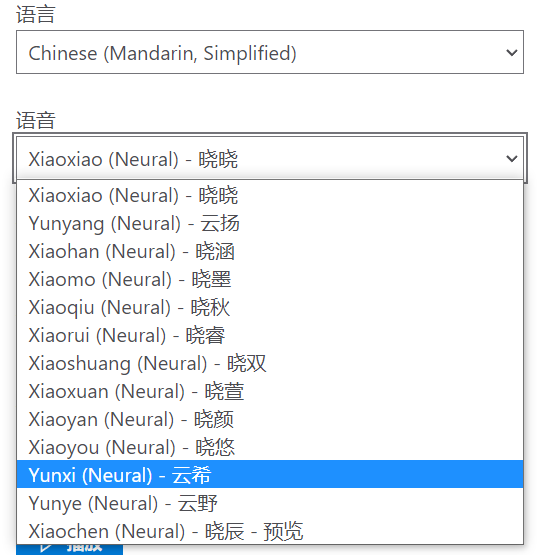

无独有偶,在微软官方提供的“文本转语音”服务中,也有一位叫“云希”的小哥,声音与魔云熙非常相似。根据我不成熟的推测,后者大概是在前者的基础上魔改而成的。

目前这类AI配音应用最广阔的领域,是无数个“XX说电影”之类的营销号。这可能是因为电影解说类视频对配音情绪配合的要求较低,也不涉及到生僻的专有名词和中英文混用。最近很多科普号也开始加入云熙小哥的阵营——说实话,云熙的声音越来越泛滥,我已经快听出PTSD了,相信会有更多人对这个声音产生生理上的抵触。

但没关系,听厌了一种配音,就会有10种新配音出现。AI配音的大流行是个不可逆的过程,因为它实在太过廉价,而且效果比前些年好了太多,在很多时候也够用,特别是对很多草根个人创作者来说。毕竟在两年前,还有无数营销号在用效果更差的“度娘音”和“谷歌音”,现在有了更好的,为什么不用呢?

而在这个过程中,很多行业发生潜移默化的变化,游戏行业也不例外。去年有个不大不小的新闻,国外一位MOD开发者为《巫师3》制作了一个新的剧情任务包,但与普通的爱好者MOD不同的是,这个任务里的杰洛特是有配音的,而且几乎和游戏正式版无异,就像视频里演示的那样:

【角色对话从第18秒开始】

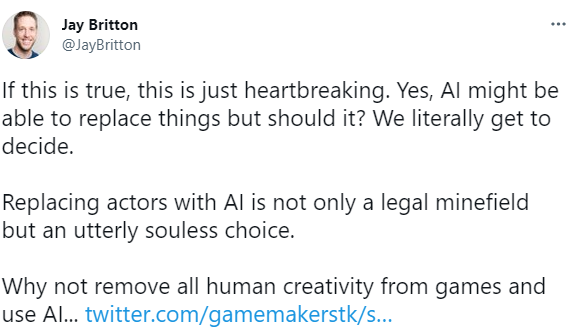

这种Mod在《巫师3》圈子里前所未有,不仅引起了大量玩家关注,也让声优们炸开了锅。因为这个Mod根本没用到人类声优,而是用杰洛特的原声进行AI训练,然后再进行语音合成,效果就好像是原版声优配音一样。

自然,这个新闻在国外引起了不小的反响,遭到很多配音演员抵制,他们表示不可接受。

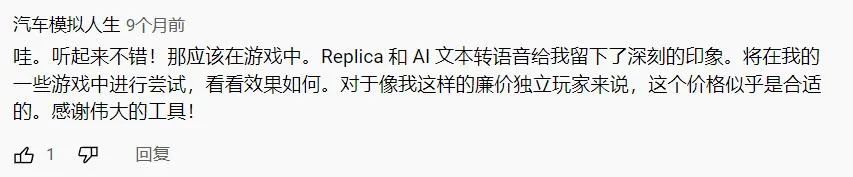

然而与此同时,国外已经出现了面向游戏的AI配音平台,而中小开发者兴奋地表示这种服务将给他们的游戏开发帮上大忙……

最后说一句,其实前两年的知名RPG《天外世界》里,已经有AI参与配音了,你,听出来了吗?